Se você está desenvolvendo com IA em 2026 e ainda não domina técnicas de prompting, você está deixando 70% da capacidade dos LLMs na mesa. Não estou exagerando - a diferença entre um prompt bem estruturado e um genérico pode ser a diferença entre uma resposta mediocre e uma solução de nível produção.

Depois de trabalhar com diversos projetos envolvendo LLMs, percebi que a maioria dos desenvolvedores subestima o poder de um bom prompt. Vamos mudar isso hoje.

Por Que Prompt Engineering Importa?

Antes de mergulharmos nas técnicas, entenda o seguinte: LLMs são máquinas de completar padrões. Eles não “entendem” no sentido humano - eles são extraordinariamente bons em continuar o padrão que você iniciou. Por isso, como você inicia esse padrão (seu prompt) determina completamente a qualidade da resposta.

Pense nisso como programação declarativa: você não diz como fazer, mas descreve o quê você quer de forma tão clara que o modelo consegue inferir o caminho correto.

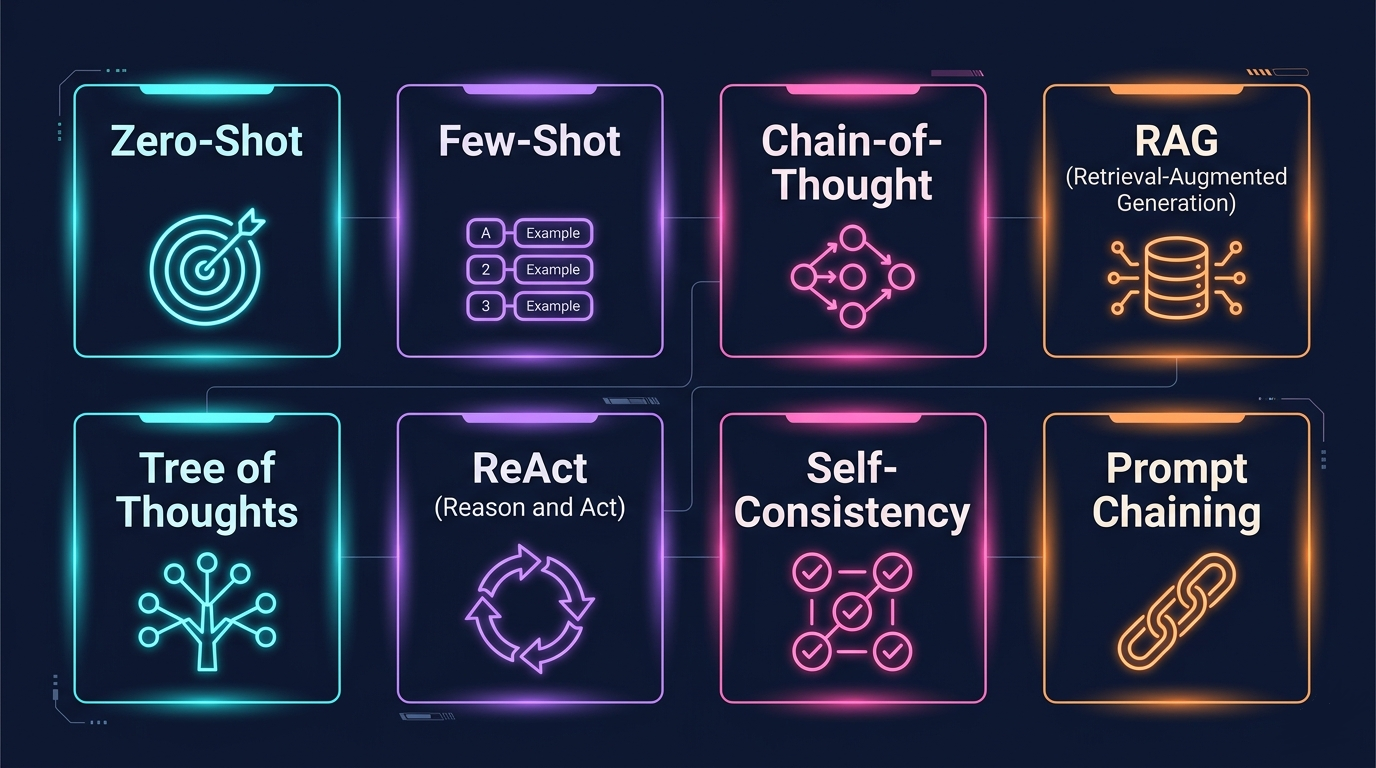

1. Zero-Shot Prompting: A Base de Tudo

O que é: Você simplesmente pede o que quer, sem exemplos prévios.

|

|

Quando usar: Esta técnica funciona bem para tarefas simples e diretas, especialmente com modelos grandes e modernos como GPT-5+ e Claude 4.5+.

Evite usar em problemas complexos ou que exigem formato específico de saída.

Dica profissional: Adicione contexto de papel (role prompting):

|

|

Funciona 3x melhor que o prompt básico.

2. Few-Shot Prompting: Ensine Por Exemplos

O que é: Como o nome diz, forneça exemplos antes de pedir a tarefa real.

|

|

Por que funciona: Você está estabelecendo o padrão exato que deseja.

O modelo aprende:

- O formato de saída (JSON)

- O nível de granularidade

- Como lidar com aspectos mistos

Quantos exemplos dar?: Cerca de 2-3 para modelos grandes e de 5-8 para modelos menores. Lembre-se, mais exemplos ≠ automaticamente melhor (pode causar confusão).

3. Chain-of-Thought (CoT): A Técnica Que Muda Tudo

Esta é, sem dúvidas, a técnica mais impactante que descobri. CoT ensina o modelo a “pensar em voz alta”.

Prompt ruim:

|

|

Prompt com CoT:

|

|

Resultado:

|

|

Quando usar CoT: Esta técnica brilha em raciocínio matemático ou lógico, debugging de código, análise de requisitos complexos e, de forma geral, qualquer tarefa que se beneficie de decomposição em etapas menores.

Zero-Shot CoT (a versão mais simples e poderosa):

Simplesmente adicione no final: "Vamos pensar passo a passo"

Sério. Essa frase mágica aumenta a taxa de acerto em problemas de raciocínio em até 40%.

4. Self-Consistency: Múltiplas Perspectivas

O conceito: Gere múltiplas respostas com CoT e escolha a mais comum.

Exemplo em código Python (com OpenAI API):

|

|

Trade-off: 5x mais chamadas de API, mas drasticamente mais confiável para decisões críticas.

Caso de uso real: Validação de regras de negócio, extração de dados estruturados de contratos, análise de compliance.

5. Generate Knowledge Prompting: Contexto Antes da Pergunta

Faça o modelo gerar conhecimento relevante antes de responder.

Abordagem ingênua:

|

|

Com Knowledge Generation:

|

|

A segunda resposta é significativamente mais precisa e detalhada porque o modelo “ativou” o contexto relevante.

Uso prático em desenvolvimento:

|

|

6. Prompt Chaining: Decomponha Tarefas Complexas

Problema: Um único prompt tentando fazer tudo resulta em respostas superficiais, perda de contexto e dificuldade de debug. A solução é usar uma cadeia de prompts especializados, onde cada um tem uma responsabilidade clara.

Exemplo - Sistema de Análise de Code Review:

|

|

Vantagens: Cada etapa é validável individualmente, fica fácil identificar onde falhou, você pode cachear etapas intermediárias para economizar chamadas de API, e ainda permite paralelização quando as etapas são independentes.

7. Tree of Thoughts (ToT): Exploração de Soluções

ToT é como CoT, mas com múltiplos caminhos de raciocínio que são avaliados.

|

|

Quando usar: Ideal para decisões arquiteturais, problemas com múltiplas soluções válidas, e especialmente quando o custo de escolher a implementação errada é alto.

Implementação simples:

|

|

8. ReAct: Raciocínio + Ação

ReAct combina pensamento e ação em ciclos iterativos. É a base de ferramentas como LangChain Agents.

Padrão:

|

|

Exemplo real - Debug de API:

|

|

9. RAG (Retrieval Augmented Generation): Conhecimento Externo

O problema fundamental dos LLMs: Conhecimento desatualizado e limitado ao treino.

RAG resolve isso:

- Retrieve: Busque informações relevantes em sua base de dados/documentos

- Augment: Injete essas informações no contexto

- Generate: Modelo responde baseado no contexto aumentado

Exemplo - Sistema de Suporte:

|

|

Dicas para RAG efetivo:

- Sempre instrua para citar fontes

- Instrua para admitir quando não sabe

- Use embedding semântico para busca (não apenas keyword)

- Teste diferentes valores de

top_k(normalmente 3-7 é ideal)

10. Meta Prompting: O Modelo Cria Seus Próprios Prompts

No nível mais avançado: Você usa o LLM para criar prompts melhores.

|

|

Resultado: Um prompt frequentemente melhor do que você escreveria manualmente.

Iteração automática:

|

|

Comparação de Técnicas: Quando Usar Cada Uma

| Técnica | Complexidade | Custo (API) | Melhor Para | Evitar Para |

|---|---|---|---|---|

| Zero-Shot | Baixa | Baixo | Tarefas simples, modelos grandes | Tarefas especializadas |

| Few-Shot | Média | Médio | Formatação específica, extração estruturada | Quando exemplos são difíceis de criar |

| Chain-of-Thought | Média | Médio | Raciocínio, matemática, lógica | Tarefas puramente criativas |

| Self-Consistency | Alta | Alto (5x) | Decisões críticas, alta precisão necessária | Tarefas simples, respostas subjetivas |

| Knowledge Gen | Média | Médio | Perguntas que precisam de contexto técnico | Fatos diretos |

| Prompt Chaining | Alta | Alto | Pipelines complexos, processos com etapas | Tarefas atômicas |

| Tree of Thoughts | Muito Alta | Muito Alto | Decisões arquiteturais, múltiplas soluções | Problemas com solução óbvia |

| ReAct | Alta | Alto | Agentes, automação, debugging | Perguntas simples |

| RAG | Alta | Médio-Alto | Conhecimento específico do domínio | Quando o conhecimento do modelo já basta |

| Meta Prompting | Muito Alta | Alto | Otimização de sistemas, produção | Prototipação rápida |

Princípios Universais: O Que Sempre Funciona

Independente da técnica:

1. Seja Específico

❌ “Melhore este código”

✅ “Refatore esta função para reduzir complexidade ciclomática abaixo de 10, mantendo a mesma interface pública”

2. Dê Contexto

Sempre inclua:

- Papel: “Você é um engenheiro de dados sênior”

- Objetivo: “O objetivo é migrar este pipeline sem downtime”

- Restrições: “Não podemos alterar o schema do banco”

3. Defina o Formato

|

|

4. Mostre, Não Apenas Diga

Em vez de “use boas práticas”, mostre:

|

|

5. Itere Baseado em Evidências

- Teste diferentes temperaturas (0.1 para consistência, 0.8 para criatividade)

- A/B teste variações de prompt

- Meça objetivamente (não confie em intuição)

Conclusão: Do Conhecimento à Maestria

Conhecer estas técnicas é o primeiro passo. Maestria vem de aplicar a técnica certa no momento certo.

Minha recomendação para começar:

- Semana 1: Domine Zero-Shot e Few-Shot em seus casos de uso reais

- Semana 2: Adicione Chain-of-Thought sempre que tiver raciocínio

- Semana 3: Implemente Prompt Chaining para seu pipeline mais complexo

- Semana 4: Experimente RAG se você tem base de conhecimento

Depois disso, você estará no top 10% dos desenvolvedores usando IA.

E lembre-se: LLMs são ferramentas, não mágica. Eles amplificam sua expertise, mas não substituem entender profundamente o domínio do problema.